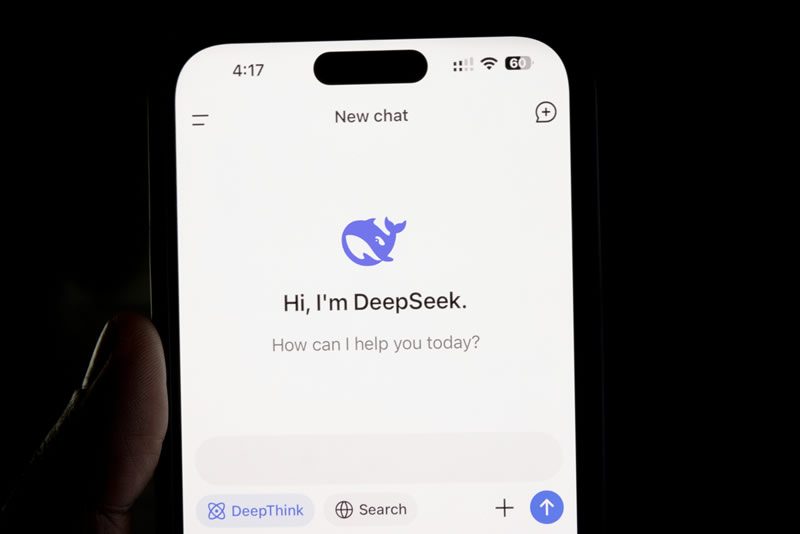

DeepSeek ужесточила цензуру в обновлённой ИИ-модели R1

Новая версия модели R1-0528 китайского стартапа DeepSeek показала высокие результаты в задачах программирования, математики и общих знаний, почти сравнявшись с флагманской моделью OpenAI GPT-4o. Однако независимое тестирование выявило, что ИИ-модель стала ещё строже цензурировать ответы, особенно касающиеся критики китайских властей.

Источник изображения: Solen Feyissa / Unsplash

Как сообщает TechCrunch, тест был проведён анонимным разработчиком под ником xlr8harder на платформе SpeechMap, которая сравнивает реакцию моделей на политически чувствительные темы. По его данным, R1-0528 значительно реже допускает дискуссионные высказывания по сравнению с предыдущими версиями DeepSeek и стала самой строго цензурированной моделью компании.

В частности, R1-0528 уклоняется от ответов о «Лагерях интернирования» в Синьцзяне, где, по данным правозащитников, были произвольно задержаны более миллиона уйгуров. Хотя в некоторых случаях модель и называет эти лагеря «нарушением прав человека», но чаще всего высказывает официальную позицию китайского правительства. Эту тенденцию подтвердили и журналисты TechCrunch в ходе собственного краткого тестирования.

Согласно закону от 2023 года, китайские разработчики искусственного интеллекта обязаны избегать создания контента, который может «навредить единству страны или социальной гармонии». Это часто трактуется как запрет на любые нарративы, противоречащие государственной политике. Для соблюдения требований компании применяют фильтры на уровне запросов или дообучают свои ИИ-модели.

Отмечается, что ещё год назад исследование показало, что оригинальная версия DeepSeek R1 отказывается отвечать на 85 % вопросов по темам, которые китайское правительство считает политически спорными. Теперь этот показатель, судя по всему, стал ещё выше.